tanuki- 2024-03-23 nnue-pytorch halfkp_1024x2-8-32 Fine-tuning Suisho10Mn_psv (2)

実験内容

- nnue-pytorch で学習した halfkp_1024x2-8-32 ネットワークを、 Suisho10Mn_psv を用いて Fine-tuning する。

- 学習率を変えて学習させる。

シャッフル条件

| 生成ルーチン | tanuki-シャッフルルーチン |

| qsearch() | あり |

| 置換表 | 無効 |

| min_progress | 0.1 |

機械学習

| 機械学習ルーチン | nnue-pytorch + やねうら王 https://github.com/nodchip/nnue-pytorch/tree/shogi.2023-10-29.halfkp_1024x2-8-32 |

| 学習モデル | halfkp_1024x2-8-32 |

| 学習手法 | ミニバッチ SGD |

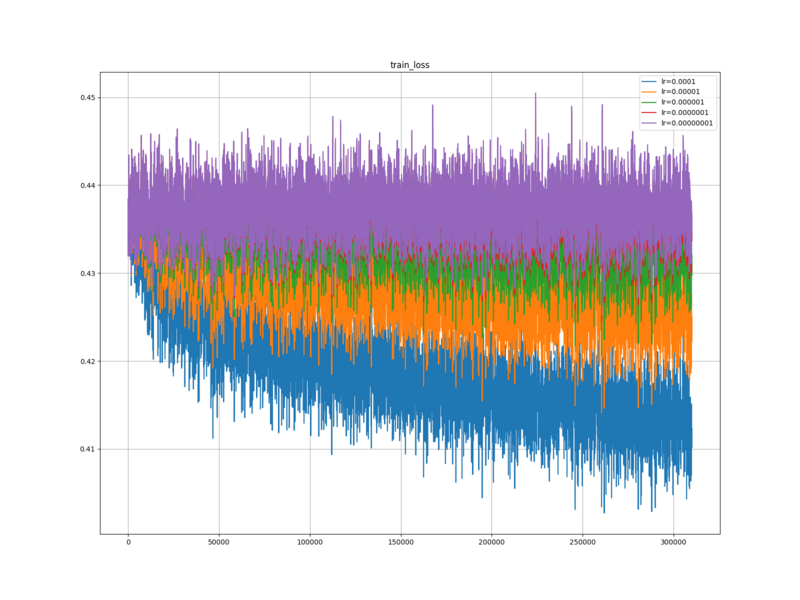

| 初期学習率 (lr) | 1e-4・1e-5・1e-6・1e-7・1e-8 |

| 最適化手法 | なし |

| 学習率調整手法 | Warmup + Newbob 風 |

| batch-size | 16384 |

| threads | 8 |

| num-workers | 8 |

| accelerator | gpu |

| devices | 1 |

| features | HalfKP |

| max-epoch | 5001 |

| score-scaling | 361 |

| lambda | 0.0 |

| 勝敗項の教師信号 | 0.999 |

| num-batches-warmup | 10000 |

| newbob-decay | 0.5 |

| epoch-size | 1000000 |

| num-epochs-to-adjust-lr | 500 |

| 学習を打ち切る下限 newbob scale | 1e-5 |

| 1 epoch 毎のネットワークパラメーターのクリップ | あり |

| ネットワークパラメーターの量子化 | 量子化なしで学習し、収束後に量子化する。 |

| ネットワークパラメーターの初期化方法 | pytorch のデフォルトの初期化手法で初期化する。 |

| 勾配の正規化 | なし |

| momentum | 0.9 |

| 入玉ボーナス | 入玉時、持ち駒および敵陣三段目までに侵入している駒について、小駒 1 枚につき 20 点、大駒 1 枚につき 100 点、敵陣三段目までに侵入している駒 1 枚につき 20 点追加する。 |

レーティング測定

| 対局相手 | https://docs.google.com/document/d/1i_h7rxPbEVP7PaUMuDjcGUtgWdOK_gj01r_yILajWZg/edit?usp=sharing tanuki-.nnue-pytorch-2024-03-06 |

| 思考時間 | 持ち時間 300 秒 + 1 手 2 秒加算 |

| 対局数 | 5000 |

| 同時対局数 | 64 |

| ハッシュサイズ | 384 |

| 開始局面 | dlshogi 互角局面集の角換わりの割合が 10% になるよう間引いたもの |

実験結果

機械学習

レーティング測定

以下は 5 億局面学習させたときのレーティングの計測結果である。

対局数=2000 同時対局数=64 ハッシュサイズ=384 開始手数=24 最大手数=320 開始局面ファイル=C:\Jenkins\workspace\TanukiColiseum.2023-04-16\TanukiColiseum\bishop_exchange.2023-06-25.sfen NUMAノード数=1 表示更新間隔(ms)=3600000

思考エンジン1 思考エンジン2

name YaneuraOu NNUE 7.63 64ZEN2 TOURNAMENT YaneuraOu NNUE 7.63 64ZEN2 TOURNAMENT

author by yaneurao by yaneurao

exeファイル C:\Jenkins\workspace\TanukiColiseum.2023-04-16\engine1\source\YaneuraOu-by-gcc.exe C:\Jenkins\workspace\TanukiColiseum.2023-04-16\engine2\source\YaneuraOu-by-gcc.exe

評価関数フォルダパス D:\hnoda\shogi\eval\tanuki-.nnue-pytorch-2024-03-20.500 D:\hnoda\shogi\eval\tanuki-.nnue-pytorch-2024-03-06

定跡手数 256 256

定跡ファイル名 no_book no_book

思考ノード数 0 0

思考ノード数に加える乱数(%) 0 0

思考ノード数の乱数を1手毎に変化させる False False

持ち時間(ms) 300000 300000

秒読み時間(ms) 0 0

加算時間(ms) 2000 2000

乱数付き思考時間(ms) 0 0

スレッド数 1 1

BookEvalDiff 30 30

定跡の採択率を考慮する false false

定跡の手数を無視する false false

SlowMover 100 100

DrawValue -2 -2

BookEvalBlackLimit 0 0

BookEvalWhiteLimit -140 -140

FVScale 16 16

Depth=0 0

MinimumThinkingTime 1000 1000

対局数2000 先手勝ち1058(55.5%) 後手勝ち849(44.5%) 引き分け93

engine1

勝ち664(34.8% R-103.5 +-15.9) 先手勝ち383(20.1%) 後手勝ち281(14.7%)

宣言勝ち28 先手宣言勝ち13 後手宣言勝ち15 先手引き分け51 後手引き分け42

engine2

勝ち1243(65.2%) 先手勝ち675(35.4%) 後手勝ち568(29.8%)

宣言勝ち19 先手宣言勝ち14 後手宣言勝ち5 先手引き分け42 後手引き分け51

664,93,1243

対局数=2000 同時対局数=64 ハッシュサイズ=384 開始手数=24 最大手数=320 開始局面ファイル=C:\Jenkins\workspace\TanukiColiseum.2023-04-16\TanukiColiseum\bishop_exchange.2023-06-25.sfen NUMAノード数=1 表示更新間隔(ms)=3600000

思考エンジン1 思考エンジン2

name YaneuraOu NNUE 7.63 64ZEN2 TOURNAMENT YaneuraOu NNUE 7.63 64ZEN2 TOURNAMENT

author by yaneurao by yaneurao

exeファイル C:\Jenkins\workspace\TanukiColiseum.2023-04-16\engine1\source\YaneuraOu-by-gcc.exe C:\Jenkins\workspace\TanukiColiseum.2023-04-16\engine2\source\YaneuraOu-by-gcc.exe

評価関数フォルダパス D:\hnoda\shogi\eval\tanuki-.nnue-pytorch-2024-03-21.500 D:\hnoda\shogi\eval\tanuki-.nnue-pytorch-2024-03-06

定跡手数 256 256

定跡ファイル名 no_book no_book

思考ノード数 0 0

思考ノード数に加える乱数(%) 0 0

思考ノード数の乱数を1手毎に変化させる False False

持ち時間(ms) 300000 300000

秒読み時間(ms) 0 0

加算時間(ms) 2000 2000

乱数付き思考時間(ms) 0 0

スレッド数 1 1

BookEvalDiff 30 30

定跡の採択率を考慮する false false

定跡の手数を無視する false false

SlowMover 100 100

DrawValue -2 -2

BookEvalBlackLimit 0 0

BookEvalWhiteLimit -140 -140

FVScale 16 16

Depth=0 0

MinimumThinkingTime 1000 1000

対局数2000 先手勝ち1166(63.1%) 後手勝ち682(36.9%) 引き分け152

engine1

勝ち880(47.6% R-15.3 +-15.2) 先手勝ち565(30.6%) 後手勝ち315(17.0%)

宣言勝ち40 先手宣言勝ち29 後手宣言勝ち11 先手引き分け73 後手引き分け79

engine2

勝ち968(52.4%) 先手勝ち601(32.5%) 後手勝ち367(19.9%)

宣言勝ち45 先手宣言勝ち23 後手宣言勝ち22 先手引き分け79 後手引き分け73

880,152,968

対局数=2000 同時対局数=64 ハッシュサイズ=384 開始手数=24 最大手数=320 開始局面ファイル=C:\Jenkins\workspace\TanukiColiseum.2023-04-16\TanukiColiseum\bishop_exchange.2023-06-25.sfen NUMAノード数=1 表示更新間隔(ms)=3600000

思考エンジン1 思考エンジン2

name YaneuraOu NNUE 7.63 64ZEN2 TOURNAMENT YaneuraOu NNUE 7.63 64ZEN2 TOURNAMENT

author by yaneurao by yaneurao

exeファイル C:\Jenkins\workspace\TanukiColiseum.2023-04-16\engine1\source\YaneuraOu-by-gcc.exe C:\Jenkins\workspace\TanukiColiseum.2023-04-16\engine2\source\YaneuraOu-by-gcc.exe

評価関数フォルダパス D:\hnoda\shogi\eval\tanuki-.nnue-pytorch-2024-03-22.500 D:\hnoda\shogi\eval\tanuki-.nnue-pytorch-2024-03-06

定跡手数 256 256

定跡ファイル名 no_book no_book

思考ノード数 0 0

思考ノード数に加える乱数(%) 0 0

思考ノード数の乱数を1手毎に変化させる False False

持ち時間(ms) 300000 300000

秒読み時間(ms) 0 0

加算時間(ms) 2000 2000

乱数付き思考時間(ms) 0 0

スレッド数 1 1

BookEvalDiff 30 30

定跡の採択率を考慮する false false

定跡の手数を無視する false false

SlowMover 100 100

DrawValue -2 -2

BookEvalBlackLimit 0 0

BookEvalWhiteLimit -140 -140

FVScale 16 16

Depth=0 0

MinimumThinkingTime 1000 1000

対局数2000 先手勝ち891(56.9%) 後手勝ち674(43.1%) 引き分け435

engine1

勝ち858(54.8% R26.3 +-15.3) 先手勝ち497(31.8%) 後手勝ち361(23.1%)

宣言勝ち36 先手宣言勝ち17 後手宣言勝ち19 先手引き分け188 後手引き分け247

engine2

勝ち707(45.2%) 先手勝ち394(25.2%) 後手勝ち313(20.0%)

宣言勝ち25 先手宣言勝ち7 後手宣言勝ち18 先手引き分け247 後手引き分け188

858,435,707

対局数=2000 同時対局数=64 ハッシュサイズ=384 開始手数=24 最大手数=320 開始局面ファイル=C:\Jenkins\workspace\TanukiColiseum.2023-04-16\TanukiColiseum\bishop_exchange.2023-06-25.sfen NUMAノード数=1 表示更新間隔(ms)=3600000

思考エンジン1 思考エンジン2

name YaneuraOu NNUE 7.63 64ZEN2 TOURNAMENT YaneuraOu NNUE 7.63 64ZEN2 TOURNAMENT

author by yaneurao by yaneurao

exeファイル C:\Jenkins\workspace\TanukiColiseum.2023-04-16\engine1\source\YaneuraOu-by-gcc.exe C:\Jenkins\workspace\TanukiColiseum.2023-04-16\engine2\source\YaneuraOu-by-gcc.exe

評価関数フォルダパス D:\hnoda\shogi\eval\tanuki-.nnue-pytorch-2024-03-24.500 D:\hnoda\shogi\eval\tanuki-.nnue-pytorch-2024-03-06

定跡手数 256 256

定跡ファイル名 no_book no_book

思考ノード数 0 0

思考ノード数に加える乱数(%) 0 0

思考ノード数の乱数を1手毎に変化させる False False

持ち時間(ms) 300000 300000

秒読み時間(ms) 0 0

加算時間(ms) 2000 2000

乱数付き思考時間(ms) 0 0

スレッド数 1 1

BookEvalDiff 30 30

定跡の採択率を考慮する false false

定跡の手数を無視する false false

SlowMover 100 100

DrawValue -2 -2

BookEvalBlackLimit 0 0

BookEvalWhiteLimit -140 -140

FVScale 16 16

Depth=0 0

MinimumThinkingTime 1000 1000

対局数2000 先手勝ち861(54.7%) 後手勝ち713(45.3%) 引き分け426

engine1

勝ち831(52.8% R15.3 +-15.2) 先手勝ち460(29.2%) 後手勝ち371(23.6%)

宣言勝ち35 先手宣言勝ち20 後手宣言勝ち15 先手引き分け197 後手引き分け229

engine2

勝ち743(47.2%) 先手勝ち401(25.5%) 後手勝ち342(21.7%)

宣言勝ち45 先手宣言勝ち22 後手宣言勝ち23 先手引き分け229 後手引き分け197

831,426,743

対局数=2000 同時対局数=64 ハッシュサイズ=384 開始手数=24 最大手数=320 開始局面ファイル=C:\Jenkins\workspace\TanukiColiseum.2023-04-16\TanukiColiseum\bishop_exchange.2023-06-25.sfen NUMAノード数=1 表示更新間隔(ms)=3600000

思考エンジン1 思考エンジン2

name YaneuraOu NNUE 7.63 64ZEN2 TOURNAMENT YaneuraOu NNUE 7.63 64ZEN2 TOURNAMENT

author by yaneurao by yaneurao

exeファイル C:\Jenkins\workspace\TanukiColiseum.2023-04-16\engine1\source\YaneuraOu-by-gcc.exe C:\Jenkins\workspace\TanukiColiseum.2023-04-16\engine2\source\YaneuraOu-by-gcc.exe

評価関数フォルダパス D:\hnoda\shogi\eval\tanuki-.nnue-pytorch-2024-03-25.500 D:\hnoda\shogi\eval\tanuki-.nnue-pytorch-2024-03-06

定跡手数 256 256

定跡ファイル名 no_book no_book

思考ノード数 0 0

思考ノード数に加える乱数(%) 0 0

思考ノード数の乱数を1手毎に変化させる False False

持ち時間(ms) 300000 300000

秒読み時間(ms) 0 0

加算時間(ms) 2000 2000

乱数付き思考時間(ms) 0 0

スレッド数 1 1

BookEvalDiff 30 30

定跡の採択率を考慮する false false

定跡の手数を無視する false false

SlowMover 100 100

DrawValue -2 -2

BookEvalBlackLimit 0 0

BookEvalWhiteLimit -140 -140

FVScale 16 16

Depth=0 0

MinimumThinkingTime 1000 1000

対局数2000 先手勝ち1026(60.5%) 後手勝ち671(39.5%) 引き分け303

engine1

勝ち855(50.4% R2.3 +-15.2) 先手勝ち516(30.4%) 後手勝ち339(20.0%)

宣言勝ち38 先手宣言勝ち21 後手宣言勝ち17 先手引き分け150 後手引き分け153

engine2

勝ち842(49.6%) 先手勝ち510(30.1%) 後手勝ち332(19.6%)

宣言勝ち53 先手宣言勝ち31 後手宣言勝ち22 先手引き分け153 後手引き分け150

855,303,842

| lr | レーティング差 |

| 1e-4 | -103.5 |

| 1e-5 | -15.3 |

| 1e-6 | 26.3 |

| 1e-7 | 15.3 |

| 1e-8 | 2.3 |

学習ロスと検証ロスは、学習が進むにつれて下がっていった。

学習ロスと検証ロスは、学習率が高いほど大きく下がった。

学習ロスと検証ロスは、学習率が 1e-8 のときにはほとんど下がらなかった。

レーティングは、学習率が 1e-4・1e-5 のときに有意に下がった。学習率が 1e-6・1e-7 のときは有意に上がった。

考察

学習ロスと検証ロスが、学習が進むにつれて下がっていったことは、学習データに対する過学習が起こらなかったことを表していると思う。

学習ロスと検証ロスが、学習率が 1e-8 のときにほとんど下がらなかったのは、アンダーフローが発生し、ネットワークパラメーターがほとんど変化しなかったことが原因だと思う。

レーティングが、学習率が 1e-4・1e-5 で有意に下がったのは、教師データに対する過学習が怒ったためだと思う。

レーティングが、学習率が 1e-6・1e-7 で有意に上がったのは、元のネットワークパラメーターの性質をあまり壊すことなく、教師データの良い部分を学習できたためだと思う。

レーティングが、学習率が 1e-8 でほとんど変わらなかったのは、ネットワークパラメーターがほとんど変化しなかったためだと思う。

まとめ

nnue-pytorch で学習した halfkp_1024x2-8-32 ネットワークを、 Suisho10Mn_psv を用いて Fine-tuning した。その際、学習率を変えて学習させた。

レーティングは、学習率が 1e-4・1e-5 のときに有意に下がった。学習率が 1e-6・1e-7 のときは有意に上がった。

レーティングが、学習率が 1e-4・1e-5 で有意に下がったのは、教師データに対する過学習が怒ったためだと思う。レーティングが、学習率が 1e-6・1e-7 で有意に上がったのは、元のネットワークパラメーターの性質をあまり壊すことなく、教師データの良い部分を学習できたためだと思う。レーティングが、学習率が 1e-8 でほとんど変わらなかったのは、ネットワークパラメーターがほとんど変化しなかったためだと思う。

次回は、学習率が 1e-6・1e-7 とのきについて、学習局面数を増やしたときのレーティングを測定したい。